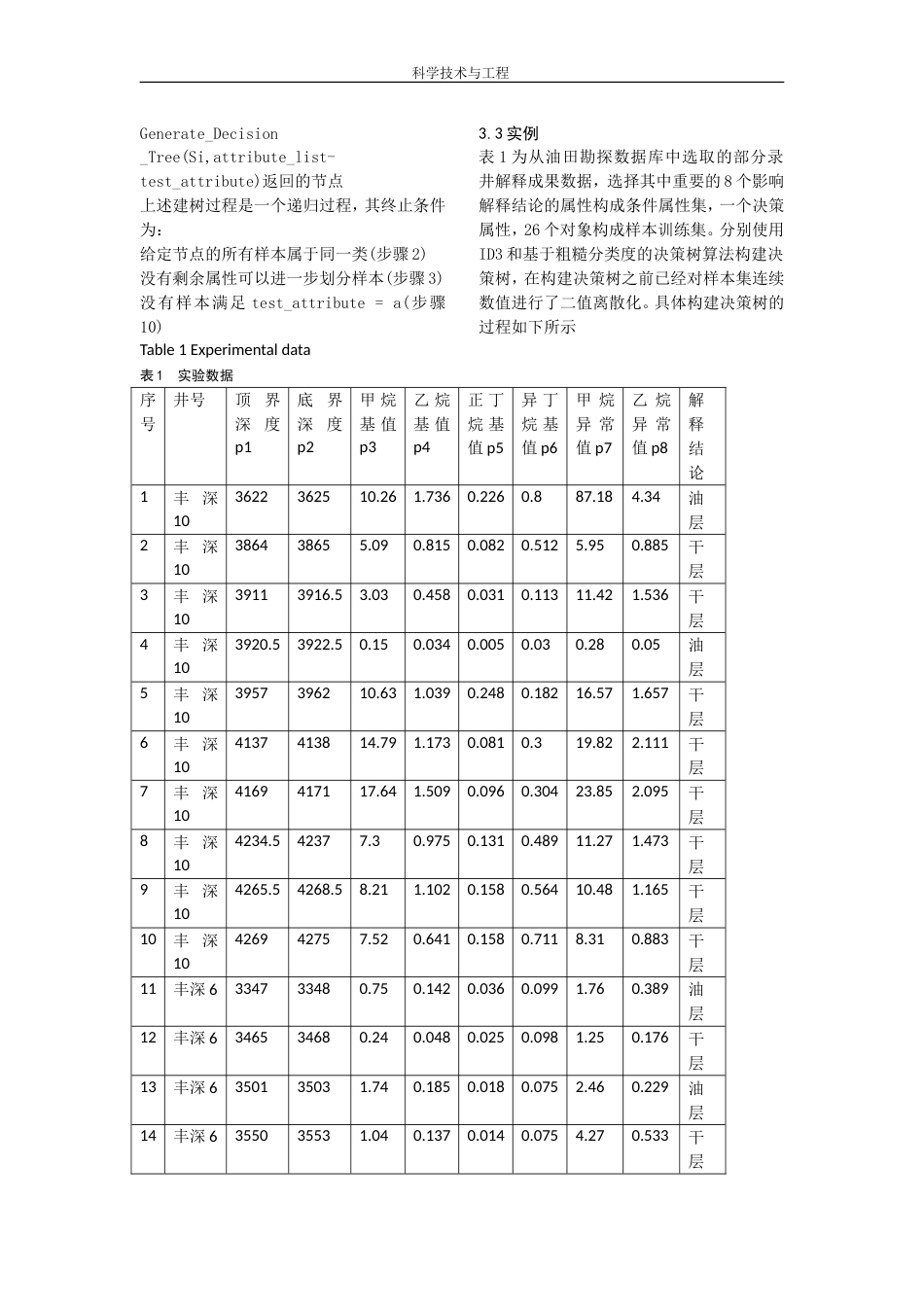

科学技术与工程基于粗糙分类度的决策树算法吴明泉1,刘童璇1,陈晓伟1(中国石油大学(华东)计算机与通信工程学院东营257061)1摘要在构造决策树的过程中,属性分裂标准直接影响分类的效果。本文针对ID3算法对属性分类精度强调不足问题,基于粗糙集理论提出了粗糙分类度的概念,将粗糙分类度作为选择分离属性的标准。该方法充分考虑了属性分类精度对分类结果造成的影响,兼顾了条件属性与决策属性的依赖性。经实验证明,相比传统的基于信息熵方法构造的决策树,有效的提高了分类的准确率。关键词分类精度;属性相关程度;粗糙集;决策树;信息增益中图分类号:TP182文献标识码:AAnAlgorithmforDecisionTreeConstructionBasedonDegreeofRoughClassificationZHANGQiong-sheng1,WUMing-quan1,LIUTong-xuan1,CHENXiao-wei1,(CollegeofComputerandCommunication,ChinaUniversityofPetroleum,Dongying257061,China)1AbstractIntheprocessofdecisiontreeconstruction,propertydivisionstandardsdirectlyaffecttheclassificationresults.AimedatweaknessofID3innicetyofgrading,weprovidetheconceptofdegreeofroughclassificationasselectcriteriaofseparationofproperty.Themethodtookintoaccountnicetyofgradinganddependencybetweenconditionattributesanddecisionattributes.Comparedwithtraditionaldecisiontreebasedentropy,theexperimentprovedthatthedecisiontreeconstructedinourmethodeffectivelyimprovestheclassificationresults.KeywordsClassificationAccuracy;AttributeRelevance;RoughSet;DecisionTree;InformationGain1引言决策树学习是以示例学习为基础的归纳推理算法,着眼于从一组无次序、无规则的事例推出决策树表示形式的规则。在解决分类问题的各种方法中,决策树方法是运用最广泛的一种,它采用自顶向下、分而治之的方法将搜索空间分为若干个互不相交的子集,形成一种类似于流程图的树状结构,这种方法速度快、易于转换成简单而便于理解的分类规则。ID3[2]算法是一种基于信息熵的决策树学习算法,是决策树算法的代表,但是基于信息熵的方法只考虑了属性之间的互信息,即属性对决策结果的影响,而没有考虑构建决策树的分类精度,从而降低了分类的效率和效果。基金项目:中国石油化工股份有限公司基金项目(P02049)作者简介:张琼声(1968-),女,副教授,主要研究领域为软件工程、智能系统,操作系统等;吴明泉(198?)男,硕士研究生,主要研究领域为操作系统、智能系统.刘童璇(1985-),男,硕士研究生,主要研究领域为操作系统.、软件工程。陈晓伟(1985-),女,硕士研究生,主要研究领域为专家系统、软件工程;E-mail:zqsheng@upc.edu.cn粗糙集理论是波兰数学家Z.Pawlak在1982年提出的一种分析数据的数学理论,主要用来处理不确定和不精确信息。其特点是不需要预先给定某些特征和属性的数量描述,而是直接从给定问题的描述集合出发,找出该问题的内在规律,其基本思想更接近现实情况。现已有部分研究将粗集理论应用于决策树中,如文献[1]先对样本集进行属性约简,然后根据核构建决策树,该方法构建的决策树通过使用属性约简后去除了噪声和冗余属性。文献[6]定义了分辨率,使用分辨率作为分裂属性的标准来构建决策树。科学技术与工程文献[7]使用粗糙集中的属性分类粗糙度作为分裂属性的标准,根据属性分类粗糙度构建决策树,另外文中提出使用变精度粗糙集去除噪声的方法。文献[8][9]都使用了边界域作为分裂属性的标准,其中[9]为避免决策树过于细化而引入了抑制因子,当抑制因子小于一定值后,决策树不再扩展。文献[12]提出使用核属性和辨明矩阵来选择对分类贡献最大的属性。文献[13]中提出了使用决策属性对条件属性的依赖度作为启发信息来选择属性。本文提出使用粗糙分类度来构建决策树。基于粗糙分类度的决策树是以属性分类精度和条件属性与决策属性的依赖性作为分裂属性的标准。属性的粗糙分类度越大,说明属性中包含的确定因素越多并且该属性与决策属性的依赖性更大。经过大量实例的分析,在分裂属性过程中,基于粗糙分类度的决策树算法所选属性的分类精度要优于ID3算...