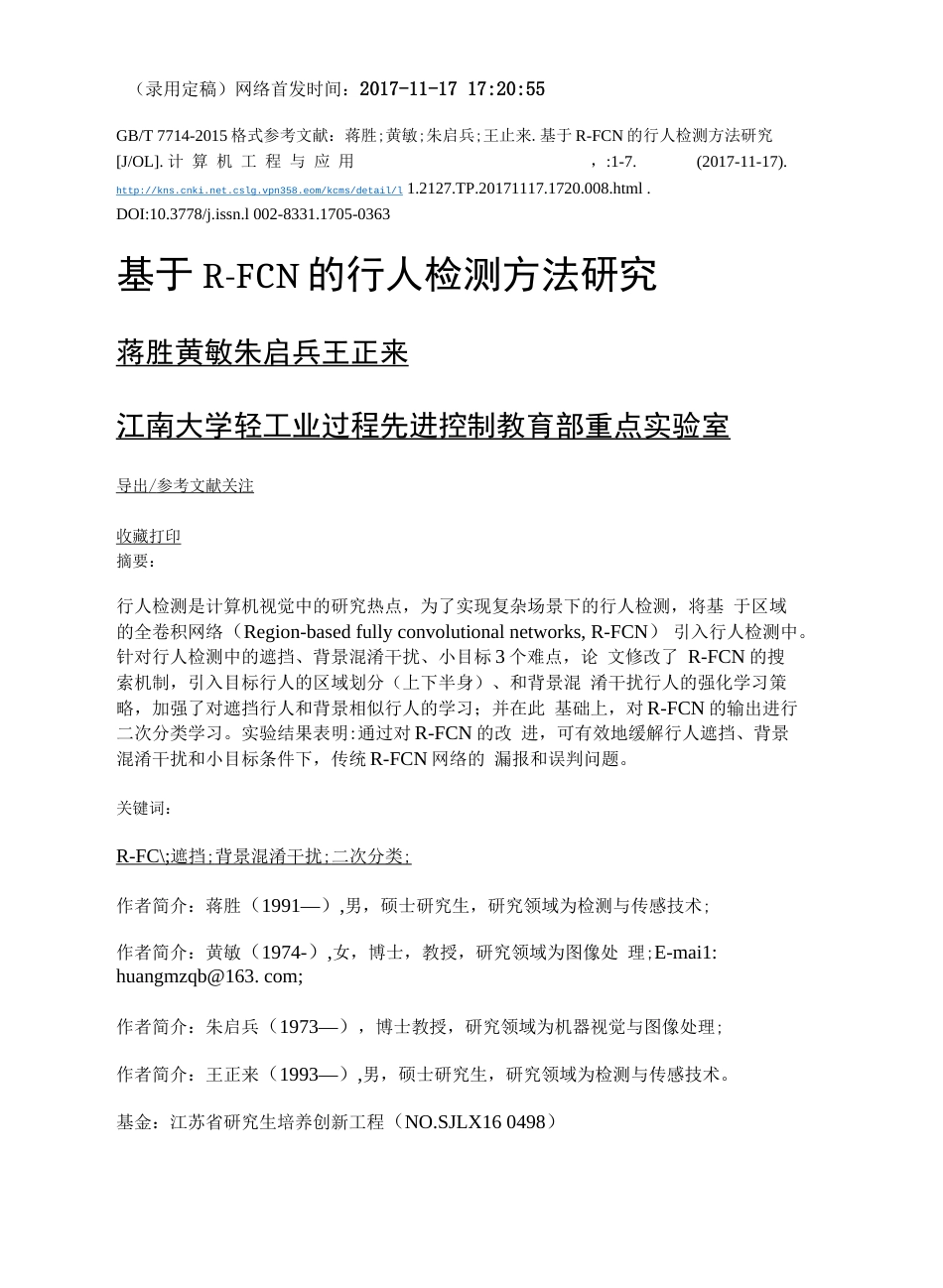

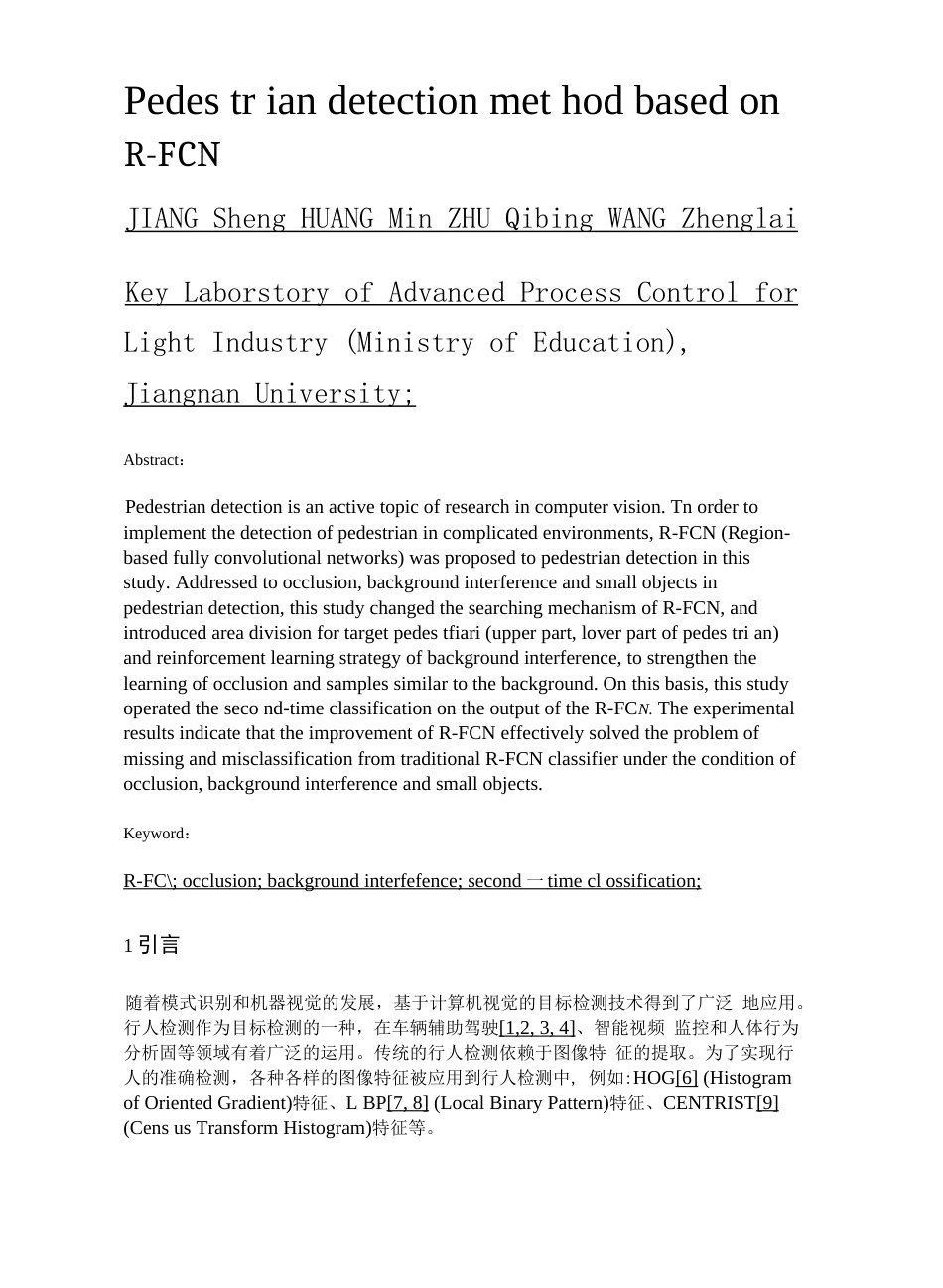

(录用定稿)网络首发时间:2017-11-1717:20:55GB/T7714-2015格式参考文献:蒋胜;黄敏;朱启兵;王止来.基于R-FCN的行人检测方法研究[J/OL].计算机工程与应用,:1-7.(2017-11-17).http://kns.cnki.net.cslg.vpn358.eom/kcms/detail/l1.2127.TP.20171117.1720.008.html.DOI:10.3778/j.issn.l002-8331.1705-0363基于R-FCN的行人检测方法研究蒋胜黄敏朱启兵王正来江南大学轻工业过程先进控制教育部重点实验室导出/参考文献关注收藏打印摘要:行人检测是计算机视觉中的研究热点,为了实现复杂场景下的行人检测,将基于区域的全卷积网络(Region-basedfullyconvolutionalnetworks,R-FCN)引入行人检测中。针对行人检测中的遮挡、背景混淆干扰、小目标3个难点,论文修改了R-FCN的搜索机制,引入目标行人的区域划分(上下半身)、和背景混淆干扰行人的强化学习策略,加强了对遮挡行人和背景相似行人的学习;并在此基础上,对R-FCN的输出进行二次分类学习。实验结果表明:通过对R-FCN的改进,可有效地缓解行人遮挡、背景混淆干扰和小目标条件下,传统R-FCN网络的漏报和误判问题。关键词:R-FC\;遮挡;背景混淆干扰;二次分类;作者简介:蒋胜(1991—),男,硕士研究生,研究领域为检测与传感技术;作者简介:黄敏(1974-),女,博士,教授,研究领域为图像处理;E-mai1:huangmzqb@163.com;作者简介:朱启兵(1973—),博士教授,研究领域为机器视觉与图像处理;作者简介:王正来(1993—),男,硕士研究生,研究领域为检测与传感技术。基金:江苏省研究生培养创新工程(NO.SJLX160498)PedestriandetectionmethodbasedonR-FCNJIANGShengHUANGMinZHUQibingWANGZhenglaiKeyLaborstoryofAdvancedProcessControlforLightIndustry(MinistryofEducation),JiangnanUniversity;Abstract:Pedestriandetectionisanactivetopicofresearchincomputervision.Tnordertoimplementthedetectionofpedestrianincomplicatedenvironments,R-FCN(Region-basedfullyconvolutionalnetworks)wasproposedtopedestriandetectioninthisstudy.Addressedtoocclusion,backgroundinterferenceandsmallobjectsinpedestriandetection,thisstudychangedthesearchingmechanismofR-FCN,andintroducedareadivisionfortargetpedestfiari(upperpart,loverpartofpedestrian)andreinforcementlearningstrategyofbackgroundinterference,tostrengthenthelearningofocclusionandsamplessimilartothebackground.Onthisbasis,thisstudyoperatedthesecond-timeclassificationontheoutputoftheR-FCN.TheexperimentalresultsindicatethattheimprovementofR-FCNeffectivelysolvedtheproblemofmissingandmisclassificationfromtraditionalR-FCNclassifierundertheconditionofocclusion,backgroundinterferenceandsmallobjects.Keyword:R-FC\;occlusion;backgroundinterfefence;second一timeclossification;1引言随着模式识别和机器视觉的发展,基于计算机视觉的目标检测技术得到了广泛地应用。行人检测作为目标检测的一种,在车辆辅助驾驶[1,2,3,4]、智能视频监控和人体行为分析固等领域有着广泛的运用。传统的行人检测依赖于图像特征的提取。为了实现行人的准确检测,各种各样的图像特征被应用到行人检测中,例如:HOG[6](HistogramofOrientedGradient)特征、LBP[7,8](LocalBinaryPattern)特征、CENTRIST[9](CensusTransformHistogram)特征等。图1R-FCN目标检测框图下载原图自然环境中背景的复杂性,拍摄角度和距离,人体姿态多样性,遮挡等因素,往往导致提取的特征的有效性难以保证,从而使得检测的精度无法满足实际应用需要。如何提高复杂场景下行人检测的精度,是目前目标检测领域的一个难点问题。近年来,基于深度学习的卷积神经网络在日标检测领域的应用得到了广泛的重视。深度卷积神经网络依靠卷积等的线性变化和激活函数的非线性映射把图片中像素级的信息映射到高维空间,使得某些任务,例如手写字体识别[10]、行人检测等,可以在高维空间轻易地实现。卷积神经网络不需要手动设计特征,其通过对图像的卷积操作,可自动实现特征的提取,已成为...