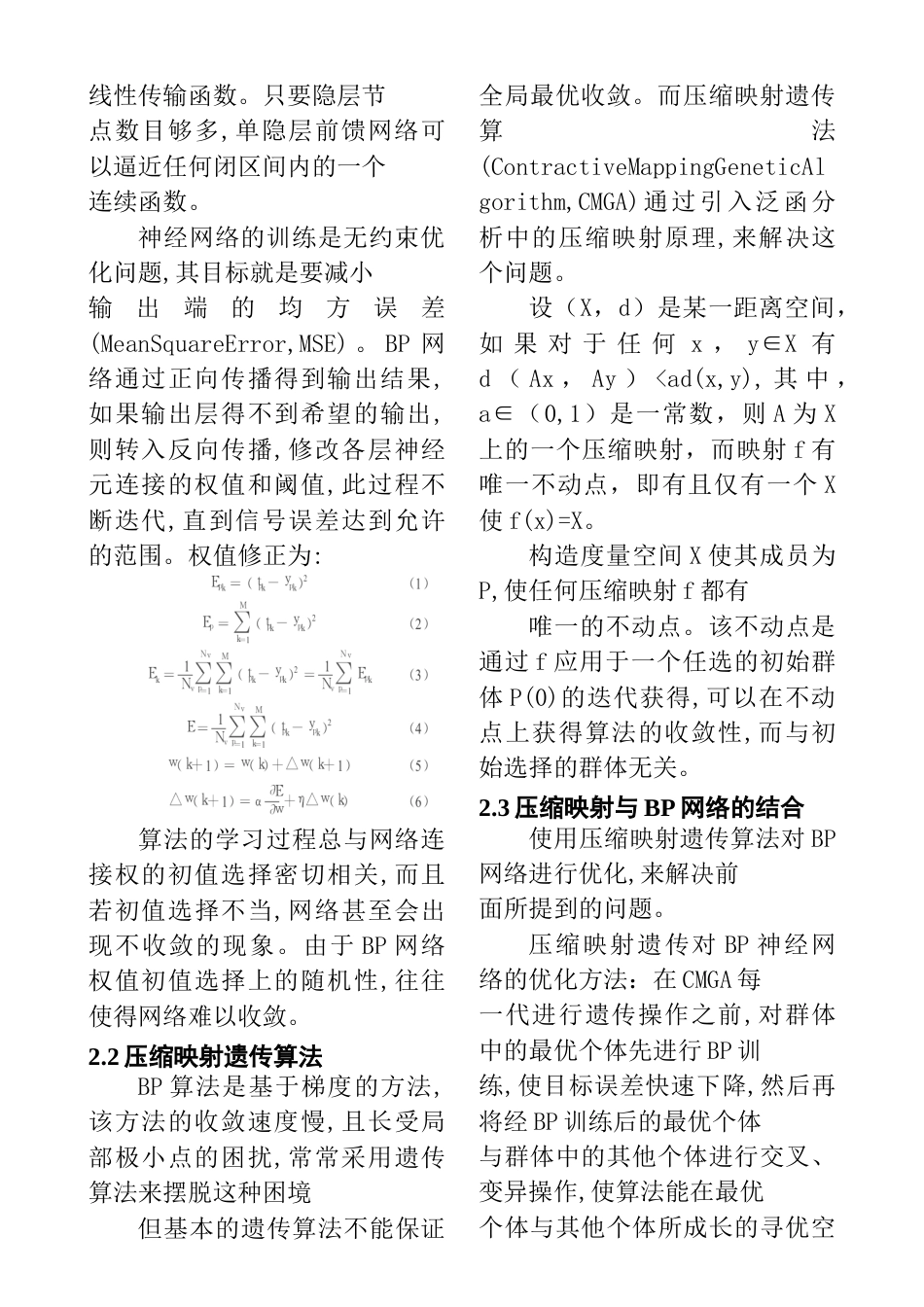

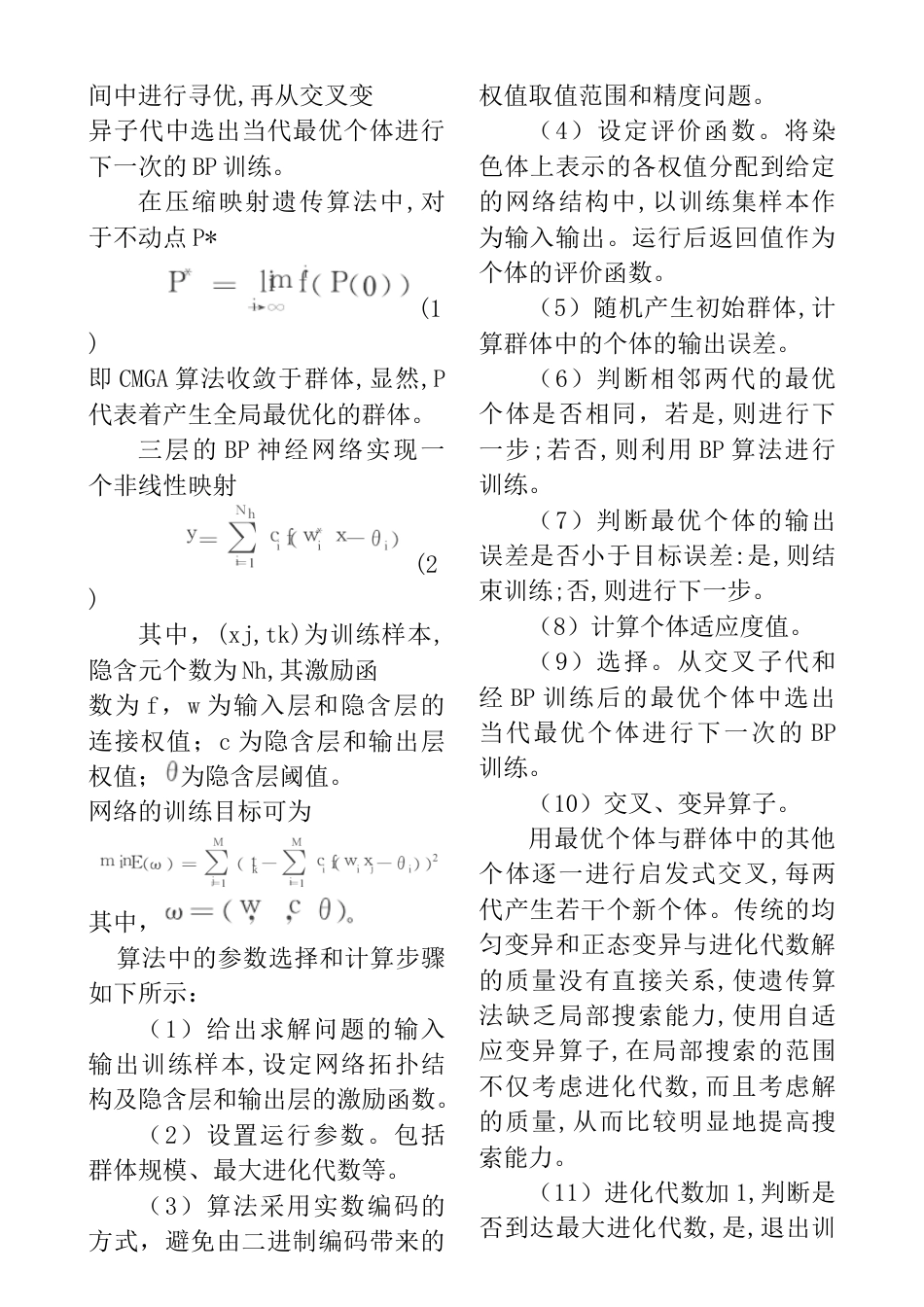

改进的BP神经网络算法的研究与应用摘要:在提高神经网络算法的快速性和稳定性问题中,针对BP算法收敛速度慢且易陷入局部极小值的缺陷,分析现有改进算法在神经网络结构优化过程中仍然存在的弊端,并利用遗传算法的特点,研究出一种改进的将压缩映射遗传与BP神经网络优化的方法。算法通过对压缩映射原理的引入,不但解决了BP算法收敛速度慢且易陷入局部极小值的问题,而且加快了BP网络的收敛速度,同时弥补BP神经网络在学习过程中与网络连接权值初值选择密切相关的不足。与传统BP算法相比,减少了训练步数,节省了训练时间,并通过数据实验验证改进的算法应用到实践中具有一定得可行性。关键词:神经网络;压缩映射;优化;权值:TP183文献标识码:Adoi:10.3778/j.issn.1002-8331ResearchandapplicationofimprovedC4.5algorithmAbstract:Inordertoimprovetherapidityandstabilityofneuralnetworkalgorithm,aimingatthedefectsofslowconvergencespeedandeasytofallintolocalminimum,theexistingBPalgorithmisanalyzed.Thealgorithmstillexistsintheprocessofneuralnetworkstructureoptimization,andusesthecharacteristicsofgeneticalgorithmtostudyanimprovedcompressionmappinggeneticandBPneuralnetwork.Themethodofnetworkoptimization.Byintroducingtheprincipleofcompressionmapping,thealgorithmnotonlysolvestheproblemthattheconvergencespeedofBPalgorithmisslowandeasytofallintolocalminimum,butalsoacceleratestheconvergencespeedoftheBPnetwork,andmakesupfortheshortageoftheBPneuralnetworkwhichiscloselyrelatedtotheinitialvalueselectionofthenetworkconnectionweightsduringthelearningprocessparedwiththetraditionalBPalgorithm,thetrainingstepisreducedandthetrainingtimeissaved,anditisfeasibletoapplytheimprovedalgorithmtopracticebydataexperiment.Keywords:neuralnetwork;compressionmapping;optimization;weight1引言BP神经网络是一种多层前馈型网络,主要通过模拟人脑的神经元应对外界的信号刺激做出的反馈行为。BP神经网络主要由三层网络构成,输入层、隐藏层和输出层,每层网络中包含多个并行的神经元信号[14]。BP神经网络主要通过信号的正向传播和误差的反向调节,找到连接不同层级之间各神经元的权值,以此来构建BP神经网络模型。在正向传播过程中,信号流经输入层、隐藏层,流向输出层。在误差反向传播中,将输出层与期望输出间的误差作为源信息,反向逐层传播,动态调整各神经元之间的连接权值和阀值。如此反复多次训练,直到模型的输出结果逼近期望输出。BP神经网络算法包括两大步骤:一个是向前传播,主要是通过给定的初始连接权值与阈值计算模型的输出值;一个是反向调节,依赖模型的输出值与实际值的误差,动态调整各神经元之间的连接权值和阀值。如此反复,直到模型的输出结果逼近期望输出。BP神经网络在实际应用中,仍有一些不足的地方。BP神经网络有众多的层数和神经单元节点,因为连接不同层级的神经元之间的权值与阈值也众多,则在实际运行中,BP神经网络受初始权值和阀值的约束,往往容易陷入局部最优,无法逼近期望输出。在研究中发现,曾有文献提出学习率自适应调整法和加速网络收敛速度的改进算法,通过分析原网络收敛速度慢等问题,对传统BP算法加以改进,是一种时变过程参数的神经元网络学习算法,但并没有很好地解决BP算法易陷入局部极小的问题。文献[2]和文献[3]提出通过设计求解最佳学习因子,更新所有权值和阈值,加快网络的收敛速度,减少训练误差,但同样没有很好地解决BP易陷入局部极小点的问题,而且改进的程度有限。文献[4]中提出一种增加结构型反馈网络称为极限学习机,有较高的泛化能力,学习速度比传统的梯度型算法快,另外,还扩展到双隐层神经网络,但是对于大多数的训练数据来说可能需要很多的隐层节点,这种方法使得计算速度减慢,因此需要更加紧密的网络结构。本文针对BP神经网络在学习过程中与网络连接权值初值选择密切相关、收敛速度慢以及易陷入极小值等缺陷,提出了一种新的基于压缩映射遗传的BP神经网络优化方法,通过对群体...